Le nombre d’organisations adoptant des technologies d’Intelligence Artificielle (IA) a augmenté de plus de 270% depuis 2015 selon Gartner. Cette technologie représente une opportunité pour faire face aux défis économiques, sociaux et sécuritaires actuels, mais également une opportunité pour les cyberattaquants qui voient chez leurs cibles une surface d’attaque augmentée, et qui peuvent s’approprier l’IA pour l’utiliser à des fins malveillantes. Elon Musk avait déjà alerté en 2017 sur les dangers d’une IA non régulée, qu’il qualifiait alors de « risque majeur » pour notre civilisation.

Quels sont les risques que présentent les attaques alimentées par l’IA et comment cette technologie est-elle développée à des fins défensives par TEHTRIS ?

Sommaire

Attaques à l’IA : Quels risques ?

Bien que pour l’heure il n’a pas été constaté d’attaques utilisant l’IA à grande échelle, il s’agit d’un type de menace qui apparaîtra sans aucun doute dans un futur proche. L’utilisation de l’IA permettra d’augmenter la vitesse, l’échelle et le niveau de sophistication des attaques menées. Ainsi, l’IA pourrait être utilisée pour :

- Améliorer les phases de reconnaissance et la pratique du social engineering : en scannant des données relatives à un individu-cible (sur les réseaux sociaux, dans ses correspondances mails etc.), l’IA permettrait d’usurper avec précision l’identité de la cible. Des mails de spearphishing sur-mesure reprenant le ton, la personnalité et les habitudes de langage dudit individu rendra l’attaque très difficile à détecter.

- Améliorer la phase d’intrusion et d’attaque grâce à la prise en compte du contexte: un logiciel malveillant doté d’IA pourra s’adapter à son environnement pour se fondre dans la masse et éviter la détection, notamment en reproduisant le comportement d’un utilisateur humain. Après observation, il pourra apprendre en temps réel à cibler un endpoint spécifique ou décider de s’autodétruire ou se mettre en pause. Il sera également en mesure d’extraire des données de façon discrète en se contentant de cibler les données d’intérêt stratégique.

- Corrompre des systèmes d’IA en introduisant des données erronées: l’une des menaces les plus actuelles concernent le risque contre d’autres systèmes d’IA. Un cyberattaquant peut accéder et altérer le stock de données utilisées pour « l’ apprentissage » de l’algorithme d’IA, mettant en péril son bon fonctionnement. De même, si une attaque venait modifier les données entrantes, elle permettrait d’influer sur la réponse de l’IA. Ces attaques visant à faire dysfonctionner le système d’IA présentent de graves risques, dans le cadre des voitures autonomes ou d’appareils industriels par exemple.

TEHTRIS CYBERIA : Répondre à l’IA avec l’IA

Les experts en cybersécurité doivent aujourd’hui faire face à de multiples défis : nombre record d’attaques, manque de personnel qualifié, cyber-fatigue des analystes SOC, sophistication accrue des activités… Cet environnement continuellement menaçant nécessite déjà une utilisation de l’IA en cyberdéfense qui devra s’adapter à des attaques par IA.

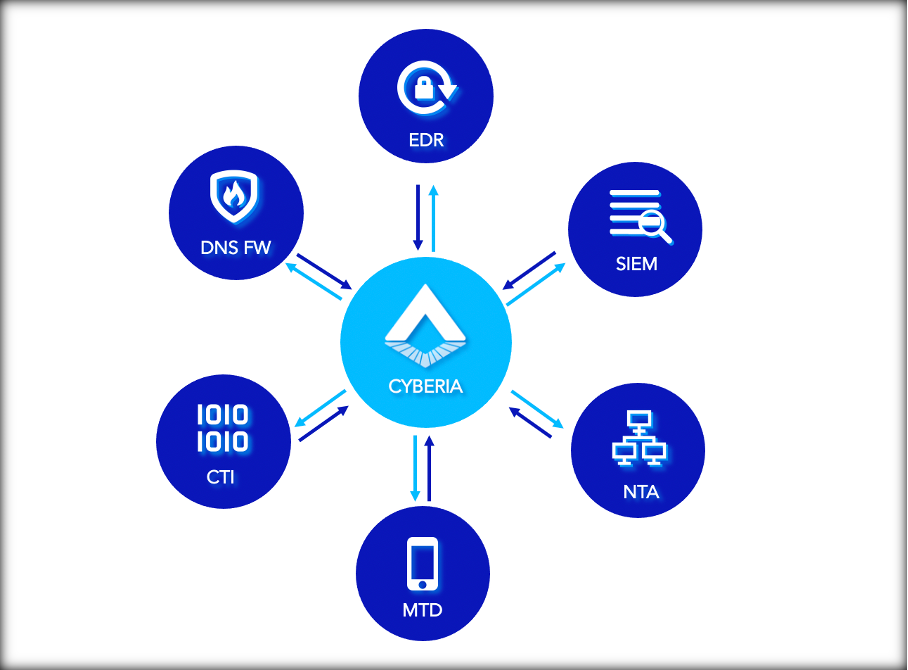

TEHTRIS développe son intelligence artificielle multi-modulaire, CYBERIA, au sein de la XDR pour proposer une réponse autonome et immédiate, s’appuyant sur une analyse à trois niveaux : analyse de fichiers, analyse comportementale et analyse des alertes et événements de sécurité. L’IA défensive identifie tout comportement anormal, même si l’activité déviante est « subtile », c’est-à-dire difficile à détecter, et arrête les attaques. Le SIEM TEHTRIS, outil de gestion des informations et des événements de sécurité permet de collecter des données massives afin d’alimenter les réponses de sécurité et d’affiner les analyses comportementales de l’utilisateur (UEBA).

L’IA et le Machine Learning utilisés à des fins de cybersécurité chez TEHTRIS permettent :

- La détection de menaces évoluées – même des modèles d’attaques jusqu’alors inconnus – en se basant sur des caractéristiques inhérentes, au lieu de signatures. Par exemple, si un morceau du logiciel est construit pour rapidement chiffrer de nombreux fichiers en même temps, les systèmes IA et Machine Learning pourront détecter un comportement suspicieux. Si le logiciel prend des mesures pour se rendre indétectable et se cache, ce sera également un autre signe qu’il n’est pas légitime.

- L’automatisation de la réponse, basée sur un apprentissage permanent à la suite de chaque incident, qui permet de réaliser des tâches nombreuses et répétitives, comme répondre au volume important d’alertes de risques mineurs pour prioriser les incidents que doivent traiter les analystes.

La technologie CYBERIA est implémentée dans l’ensemble des produits TEHTRIS pour permettre de prioriser les alertes et d’optimiser la détection de malware et de comportements malveillants. CYBERIA résulte d’une combinaison de techniques d’avant-garde en Machine Learning, Deep Learning, Active Learning et Reinforcement Learning. Elle est alimentée de données contextualisées issues du Big Data. Sa capacité à prioriser les alertes remontées aux analystes a été valorisée dans le cadre de l’initiative publique française France Relance qui a retenu le projet CYBERIA « Soc in the box 2.0 » comme lauréat du Grand Défi Cyber en juin 2021.

Enjeux de l’utilisation de l’IA en cyber

Un enjeu de taille que présente l’IA en cybersécurité réside dans la notion d’explicabilité. En effet, les systèmes d’IA sont souvent comparés à des boîtes noires : le processus décisionnel est opaque dû à la nature même de la technologie qui est en constante adaptation et évolution. Ainsi, la notion d’IAX (Intelligence Artificielle eXplicable) vise à rendre ce process plus transparent – et donc explicable – et à donner une visibilité sur le contexte ayant mené à une prise de décision par IA.

L’IAX vise donc à :

- Contextualiser un résultat issu de l’IA pour l’analyste, qui pourra s’appuyer dessus pour en évaluer la pertinence ou étoffer la réponse face à une menace.

- Améliorer le système d’IA si des biais sont observés par le data scientist, car il lui serait alors possible d’identifier où et pourquoi de tels biais se sont formés et donc de prendre des mesures pour les atténuer.

- A fortiori, identifier une attaque visant à corrompre un système d’IA en contrôlant la qualité des données.

De manière plus générale, l’explicabilité est un champ de recherche en plein expansion qui entend, d’une part, perfectionner les modèles d’IA et l’utilisation de leurs prédictions, et d’autre part, augmenter de façon générale la confiance des acteurs envers cette technologie.

Il est à souligner que la dimension éthique de l’utilisation de l’IA représente un autre enjeu non négligeable. Des efforts visant à encadrer l’utilisation de ces technologies sont observés, tant au niveau d’organisations internationales (la Commission Européenne a présenté un livre blanc sur la stratégie en matière d’IA en 2020) que d’acteurs privés (Microsoft a récemment publié son deuxième livre blanc en faveur d’une « intelligence responsable »). TEHTRIS, qui a fait de l’éthique une valeur fondamentale de son activité, entend utiliser sa technologie IA afin de contribuer à sécuriser le cyberespace. Les données alimentant CYBERIA, et notamment sa technologie d’analyse comportementale (UEBA), sont anonymisées afin de garantir la confidentialité des données personnelles.

Ainsi, l’augmentation et l’amélioration de la technologie de l’IA accroit de facto la possibilité d’utiliser l’IA à des fins malveillantes. Cette escalade engendre le besoin d’utiliser l’IA de manière défensive puisqu’une attaque offensive alimentée par l’IA exclut une réponse « humaine » qui ne serait pas proportionnée. Les attaques, qui permettront un ciblage plus précis et sophistiqué, seront plus impactantes tant dans les phases de reconnaissance que d’intrusion, bénéficiant d’un contexte et d’une analyse comportementale en temps réel. En réponse, l’IA défensive permet déjà d’analyser et de répondre instantanément à tout comportement anormal observé et de détecter des menaces élaborées. En parallèle, le manque de données en cybersécurité, dans ce domaine en constante évolution, ne permet pas à l’IA de pouvoir se développer pleinement sur une base de données stables. Ainsi en cyberdéfense, l’IA doit être utilisée en complément des règles fondamentales de cybersécurité et d’autres outils tels que la cryptographie. En effet, le combat IA contre IA s’articulera autour de la problématique suivante : quelle IA aura le plus de données pour être meilleure que l’autre ? Bénéficiant de plus de 5 ans de recherche et développement, les modules CYBERIA de TEHTRIS s’appuient sur des bases de données riches qui permettent de constamment ajuster et améliorer leur usage dans les produits composants la TEHTRIS XDR Platform. A titre d’exemple, le DNS Firewall TEHTRIS intègre un modèle de Deep Learning permettant de détecter les noms de domaines générés aléatoirement (DGA) avec une fiabilité de 99% et détectant 100% des attaques SolarWinds.